Die Renaissance der Rechenzentren

Rechenzentrumslandschaft wird diverser

von Hartmut Wiehr - 04.07.2022

Die umwälzende, von Gartner 2019 angekündigte Rechenzentrumsrevolution ist bislang ausgeblieben. Bereits 2020 rūckte das Analystenhaus denn auch wieder etwas ab von seiner steilen These, wie die Studie „Your Data Center May Not Be Dead, but It’s Morphing“ vom September 2020 zeigt, in der der Begriff „Hybrid Digital Infrastructure Management (HDIM)“ geprägt wurde. Auch die Analysten der Enterprise Strategy Group (ESG) sprechen in einer Studie vom Mai 2020 von „Hybrid Cloud Trends“.

Die Entwicklung hin zu einer neuen Diversität wird auch deutlich, wenn man sich die wesentlichen Merkmale einer Cloud-Installation näher ansieht. Wenn Unternehmen Teile oder die komplette Ausrüstung für ihre Daten und Workloads in ein Cloud-Rechenzentrum auslagern, dann befinden sich diese in physischen Infrastrukturen, wie man sie in den klassischen Rechenzentren von Unternehmen vorfindet – allerdings nicht mehr exklusiv, sondern mit denen von anderen Unternehmenskunden.

Der Begriff Cloud bezeichnet den Umstand, dass solche zentralen Rechenzentren irgendwo anders stehen und über zugewiesene, spezielle oder allgemein zugängliche Internetleitungen mit dem Unternehmenssitz verbunden sind. Sie können sich in der gleichen Region, innerhalb eines Landes oder irgendwo auf dem Globus befinden – je nachdem, wie es die Vorgaben des jeweiligen Staates erlauben. In dieser Standortlogik kommt den Leitungen zwischen Kunden und Rechenzentrumsbetreibern eine neue Bedeutung zu: Ihr Sicherheitsstatus muss gewährleistet sein, sie können sich aber in der Praxis auch als Einfallstor für Attacken von Cyberkriminellen erweisen.

Zu den Vorteilen für den Kunden zählt, dass er sich nicht mehr selbst um Bau, Betrieb, Energieversorgung, Fachleute und physische Sicherheit seines Rechenzentrums zu kümmern braucht. Dafür trägt der Cloud-Provider die Verantwortung, ebenso wie für alle Komponenten auf Applikations- und Datenseite – Komfort gegen bare Mūnze, je nach Ausgestaltung der individuellen Verträge.

Die Cloud-Betreiber wiederum stellen für die gemeinsame Nutzung ihrer Anlagen eine virtuelle Aufteilung ihrer Server- und Storage-Ressourcen zur Verfügung – mittels virtueller Maschinen (VMs) oder gegen Aufpreis durch einen dedizierten exklusiven Ressourcenzugang. Diese Möglichkeiten unterscheiden sich je nach Provider.

Zu den prinzipiellen Vorteilen einer Public Cloud gehört die gemeinsame Nutzung von Ressourcen. Unternehmen müssen nicht mehr alles an Gebäuden und Installationen aus eigener Tasche bezahlen, sondern nur einen individuellen Anteil. Bei Erweiterungen oder Reduzierungen greifen Vertragsklauseln, die Kunden können variabler (und billiger) reagieren, die eigenen Kapitalausgaben gestalten sich kostengünstiger und Ausstattung und Anforderungen an ein eigenes IT-Team fallen geringer aus.

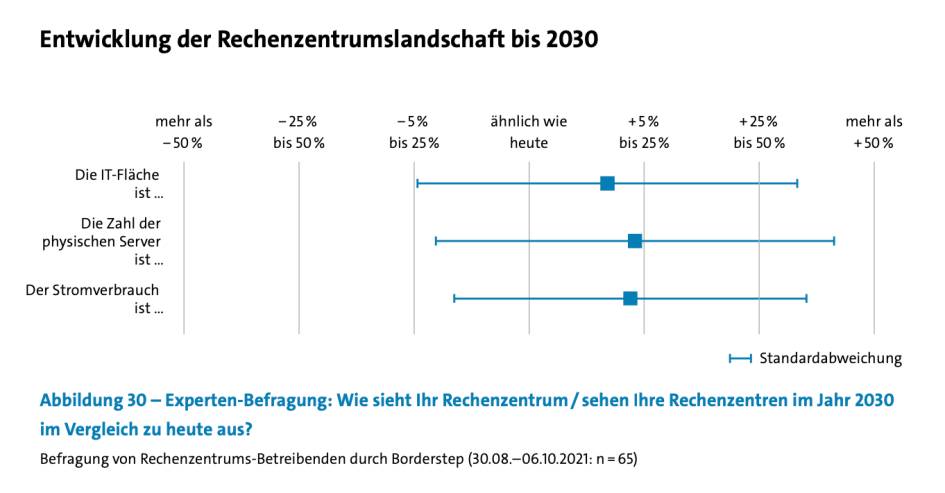

Erwartungen: mehr Fläche, mehr Server und auch mehr Stromverbrauch.

(Quelle: Borderstep )

Problematisch bleibt die mangelnde Übersicht der Kunden über „ihre“ Bestandteile der Infrastruktur im Rechenzentrum des Dienstleisters. Werden sie tatsächlich, wie in den Prospekten und vertragsmäßig versprochen, fortlaufend kontrolliert und erneuert? Wie konstant ist die Preisgestaltung? Was passiert genau, wenn man wieder aussteigen, zu einer eigenen IT zurückkehren oder zu einem anderen Provider wechseln möchte? Nicht zu vergessen: das abschreckende Beispiel der verheerenden Brandkatastrophe bei OVHcloud in Frankreich.